Tesi_Manfrin

-

Upload

paolo-manfrin -

Category

Documents

-

view

252 -

download

3

description

Transcript of Tesi_Manfrin

UNIVERSITÀ DEGLI STUDI DI TRIESTE

An application to manage and automatecommon procedures in a server farm

LAUREANDO RELATORE

Paolo Manfrin Chiar.mo Prof. Alberto Bartoli

A.A. 2007/2008

Ringraziamenti

Desidero ringraziare quanti hanno contribuito alla mia formazione e allarealizzazione di questa tesi.

In particolare ringrazio il Professor Bartoli Alberto per la revisionecritica di questa tesi, tutto il Dipartimento di SAP Business One, i TeamLeaders Valerie Maybin e Karen Martinez nonchè il Project ManagerAurelien Leblond. Ringrazio inoltre la Dott.ssa Mundt per i preziosisuggerimenti inerenti le basi dati di SAP Business One.

Concludo ringraziando la mamma Gabriella, il papà Eligio e la nonnaMaria per il sostegno durante l’intera carriera universitaria.

iii

Indice

1 Introduzione 1

2 Analisi 32.1 Descrizione del Problema . . . . . . . . . . . . . . . . . . 3

2.1.1 Contesto Aziendale . . . . . . . . . . . . . . . . . . 32.1.2 Overview Sistemi ed Entità . . . . . . . . . . . . . 42.1.3 Pratica Interna . . . . . . . . . . . . . . . . . . . . 42.1.4 Software Preesistente . . . . . . . . . . . . . . . . . 6

2.2 Analisi del Problema . . . . . . . . . . . . . . . . . . . . . 62.2.1 Definizione del Problema . . . . . . . . . . . . . . . 7

2.3 Analisi dei Requisiti . . . . . . . . . . . . . . . . . . . . . 82.3.1 Vincoli di progetto . . . . . . . . . . . . . . . . . . 82.3.2 Casi d’uso . . . . . . . . . . . . . . . . . . . . . . . 92.3.3 Planning delle attività . . . . . . . . . . . . . . . . 10

3 Progetto del Sistema 113.1 Moduli A e B: Generic Query . . . . . . . . . . . . . . . . 11

3.1.1 Il canale di comunicazione . . . . . . . . . . . . . . 113.1.2 Il Server Listener . . . . . . . . . . . . . . . . . . . 133.1.3 La Base Dati . . . . . . . . . . . . . . . . . . . . . 143.1.4 L’interfaccia Properties Framework . . . . . . . . . 19

3.2 Modulo C: Backup Manager . . . . . . . . . . . . . . . . . 223.2.1 La Procedura di Restore attuale . . . . . . . . . . 243.2.2 Problemi Rilevati . . . . . . . . . . . . . . . . . . . 243.2.3 Possibili Soluzioni . . . . . . . . . . . . . . . . . . 263.2.4 Schema E-R Backup Manager . . . . . . . . . . . . 27

3.3 Modulo D: Ridefinizione GSC Workflow . . . . . . . . . . 27

v

INDICE vi

4 Implementazione 334.1 Moduli A e B . . . . . . . . . . . . . . . . . . . . . . . . . 33

4.1.1 Properties Framework . . . . . . . . . . . . . . . . 334.1.2 Gli oggetti serializzabili . . . . . . . . . . . . . . . 344.1.3 Server Listener . . . . . . . . . . . . . . . . . . . . 364.1.4 Schema Logico Database (Schema Properties) . . . 384.1.5 Stored Procedures . . . . . . . . . . . . . . . . . . 384.1.6 Indici . . . . . . . . . . . . . . . . . . . . . . . . . 424.1.7 Triggers e Jobs . . . . . . . . . . . . . . . . . . . . 454.1.8 Transazioni . . . . . . . . . . . . . . . . . . . . . . 474.1.9 IO Risultati da server . . . . . . . . . . . . . . . . 50

4.2 MODULO C . . . . . . . . . . . . . . . . . . . . . . . . . 524.2.1 Applicazione BackupManager . . . . . . . . . . . . 534.2.2 Shrink Distribuito . . . . . . . . . . . . . . . . . . 534.2.3 Schema Logico Database (Schema BackupManager) 58

4.3 MODULO D . . . . . . . . . . . . . . . . . . . . . . . . . 60

5 Risultati ottenuti 655.1 Moduli A e B . . . . . . . . . . . . . . . . . . . . . . . . . 655.2 Modulo C . . . . . . . . . . . . . . . . . . . . . . . . . . . 655.3 Modulo D . . . . . . . . . . . . . . . . . . . . . . . . . . . 69

6 Conclusioni e Raccomandazioni 716.1 Miglioramenti moduli A e B . . . . . . . . . . . . . . . . . 716.2 Miglioramenti modulo C . . . . . . . . . . . . . . . . . . . 726.3 Considerazioni Finali . . . . . . . . . . . . . . . . . . . . . 72

A Raccolta Informazioni per la gestione query 73

B Elenco degli script realizzati 75

C Struttura base del Listener 79

D Setup dell’ambiente di test e sviluppo 81

E Interfacce Utente Applicativi 85

F Elenco dei server gestiti 91

Acronimi 95

Elenco delle figure

2.1 Business One Workflow . . . . . . . . . . . . . . . . . . . 42.2 Business One System Overview . . . . . . . . . . . . . . . 52.3 Use Case del Sistema . . . . . . . . . . . . . . . . . . . . . 9

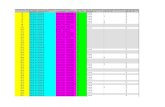

3.1 Channel . . . . . . . . . . . . . . . . . . . . . . . . . . . . 133.2 Listener . . . . . . . . . . . . . . . . . . . . . . . . . . . . 133.3 Properties Framework . . . . . . . . . . . . . . . . . . . . 143.4 Modello di Accesso ai dati . . . . . . . . . . . . . . . . . . 163.5 Schema definiti nel database TEC . . . . . . . . . . . . . . 193.6 Modello E-R Schema Properties . . . . . . . . . . . . . . . 203.7 Servizi Offerti da Properties Framework . . . . . . . . . . 213.8 Numero database ripristinati su server . . . . . . . . . . . 233.9 Totale spazio annualmente allocato sui server . . . . . . . 233.10 TEC 3 - GUI Richiesta ticket . . . . . . . . . . . . . . . . 253.11 Snapshot Sequoia . . . . . . . . . . . . . . . . . . . . . . . 273.12 Overview Backup Manager . . . . . . . . . . . . . . . . . 283.13 Modello E-R Schema BackupManager . . . . . . . . . . . 293.14 Workflow Attuale . . . . . . . . . . . . . . . . . . . . . . . 303.15 Workflow Ridefinito . . . . . . . . . . . . . . . . . . . . . 31

4.1 Interfaccia PropertiesFramework e sua implementazione . 354.2 Oggetti Serializzabili . . . . . . . . . . . . . . . . . . . . . 374.3 Servizi offerti dal Server Listener . . . . . . . . . . . . . . 394.4 Schema Logico DB (Schema Properties) . . . . . . . . . . 404.5 Stored Procedure GetRemoteQueryResult . . . . . . . . . 424.6 Stored Procedure GetSavedQueryResult . . . . . . . . . . 434.7 Livelli di Isolamenteo [16] . . . . . . . . . . . . . . . . . . 474.8 Interfaccia con la Base Dati per Backup Manager . . . . . 534.9 Interfacce e Implementazioni per Backup Manager . . . . 544.10 Schema Logico DB (Schema BackupManager) . . . . . . . 59

vii

ELENCO DELLE FIGURE viii

4.11 Directories orfane . . . . . . . . . . . . . . . . . . . . . . . 604.12 DBs non associati a Tickets . . . . . . . . . . . . . . . . . 61

5.1 Snapshot Sequoia dopo lo shrink e l’eliminazione delle cartelle orfane 665.2 Database ripristinati (media mobile su 45 gg) . . . . . . . 675.3 Database cancellati (media mobile su 45 gg) . . . . . . . . 675.4 Guadagno di spazio (in %) sui server di backend . . . . . 685.5 Ticket richiesti e ripristini manuali . . . . . . . . . . . . . 69

D.1 Configurazione SSMS . . . . . . . . . . . . . . . . . . . . . 82

E.1 GUI QueryProcessor . . . . . . . . . . . . . . . . . . . . . 85E.2 GUI ResultAnalyzer . . . . . . . . . . . . . . . . . . . . . 86E.3 GUI ServerManager . . . . . . . . . . . . . . . . . . . . . 87E.4 GUI AdminQueries . . . . . . . . . . . . . . . . . . . . . . 87E.5 GUI DisplayQueriesPlugin . . . . . . . . . . . . . . . . . . 88E.6 GUI IVUAutomation . . . . . . . . . . . . . . . . . . . . . 88

Elenco delle tabelle

3.1 Tabella Query . . . . . . . . . . . . . . . . . . . . . . . . . 183.2 Tabella Result . . . . . . . . . . . . . . . . . . . . . . . . 183.3 Tabella Batch . . . . . . . . . . . . . . . . . . . . . . . . . 183.4 Tabella Relazioni . . . . . . . . . . . . . . . . . . . . . . . 20

4.1 Analisi delle Transazioni . . . . . . . . . . . . . . . . . . . 49

ix

Capitolo 1Introduzione

L’ottimizzazione delle risorse, la riduzione dei costi e l’aumento dellacapacità produttiva aziendale, sono di particolare interesse, specialmentein momenti di crisi economica come quello che stiamo vivendo in questianni.

Questa tesi è stata sviluppata presso il SAP Global Support Center diSAP Business One, in Irlanda, al fine di migliorare il processo di supportofornito dai consulenti SAP durante le fasi di rilevamento e correzione deimalfunzionamenti sui database dei clienti. La tesi è stata sviluppata pa-rallelamente alla attività di tirocinio di 6 mesi svolto a Galway, dedicata aprendere familiarità con il prodotto SAP Business One approfondendo inparticolare i moduli Business Core (SBO-BC), Upgrade (SBO-BC-UPG)ed AddOn (SBO-BC-ADD) di SAP Business One.

Il Global Support Center è composto da consulenti SAP con cono-scenze specifiche relative all’ERP Sap Business One. Business One sibasa su un database relazionale di elevata complessità, la cui strutturainterna è descritta in [1]. Il Global Support Center offre supporto 24 x 7 alivello mondiale, risolvendo i malfunzionamenti sulla base dati in produ-zione presso i clienti SAP, che compromettono la produttività aziendale. Idatabase aziendali possono essere trasferiti in uno dei server SAP localiz-zati in Germania, dove vengono ripristinati per condurre analisi off-line.I server SAP contengono tipicamente 1800 database.

I problemi affrontati in questa tesi sono stati i seguenti:

• semplificare la modalità con cui i consulenti si connettono alle ba-se dati remote in Germania, dalle sedi in Irlanda, Israele, Slovac-chia, Cina, India, e Canada ed eseguono query non note a priori,salvandone i risultati per analisi successive.

1

1. Introduzione 2

• fornire agli altri sviluppatori una interfaccia che consenta di au-tomatizzare routine durante le procedure di backup, upgrade eispezione dei database clienti

• migliorare la gestione della server farm riducendo i crash di sistemache avvengono durante le operazioni di download e ripristino deidatabase clienti

Alcuni dei moduli sviluppati fanno già parte dell’applicativo Test En-vironement Center 4.0, attualmente in fase di sviluppo dall’ SDK Teamdi SAP Business One. Altri verranno integrati in un secondo momento,una volta ultimata la fase di testing. Il nuovo applicativo, già in uso daalcuni consulenti pilota, andrà a sostituire il precedente nei prossimi mesie verrà esteso a tutte le sedi di supporto di SAP Business One.

Durante lo sviluppo della tesi, a stretto contatto con i consulentiSAP, si è inoltre evidenziato un possibile miglioramento produttivo rag-giungibile modificando il workflow attualmente in essere. Tale modificaè stata proposta al SAP System Leader, il quale sta valutando le risorseda destinare alla implementazione della soluzione proposta.

Per quanto concerne il raggiungimento degli obiettivi, i consulentisono ora in grado di eseguire query, senza la necessità di ricorrere a MSSql Server Management Studio come dovevano fare in precedenza, nellamaggior parte dei casi.

L’interfaccia software creata consente agli sviluppatori di interagirecon le basi dati senza la necessità di conoscerne i dettagli come la loca-lizzazione fisica sui server e le stringhe di connessione, consentendo lorodi rimanere concentrati nei moduli che devono sviluppare.

Le problematiche di cui soffriva la server farm sono state in parterisolte introducendo l’operazione di shrinking sui database e cambiandoi parametri relativi alle stored procedures di eliminazione dei database.

Gli applicativi software utilizzati sono stati Visual Studio 2005, SqlServer 2000, Sql Server 2005, Sql Profiler, Tortoise SVN per la gestione delversioning, Sequoia e SAP Business One. Il linguaggi di programmazioneutilizzati sono stati C# e Sql.

Il capitolo 2 inizia discutendo i problemi da risolvere, l’analisi deirequisiti ed i casi d’uso. Il capitolo 3 riporta il progetto del sistema e dellabase dati, seguito dal capitolo 4 in cui viene descritta l’implementazionedel sistema. La trattazione continua con il capitolo 5 in cui vengonoanalizzati i risultati e si conclude nel capitolo 6 con la proposta di ulteriorimiglioramenti.

Capitolo 2Analisi

2.1 Descrizione del Problema

Per poter identificare le problematiche da risolvere è stato necessario com-prendere chiaramente l’organizzazione aziendale e come i vari dipartimen-ti interagiscono tra loro. Tale analisi risulterà di particolare importanzaspecialmente per la fase di progettazione della base dati e la modifica delworkflow.

2.1.1 Contesto Aziendale

Questo capitolo descrive come il Dipartimento di SAP Business One èorganizzato per fornire supporto all’utente finale. Possiamo identificare4 attori principali all’interno di Business One (B1):

• L’Utente Finale: è una azienda che usa il prodotto SAP BusinessOne come Enterprise Resource Planning (ERP)

• Il partner SAP: è un rivenditore/consulente punto di contatto peril cliente. Quando un utente finale ha qualche problema con B1contatta il partner il quale ha il compito di valutare il problemasollevato dal cliente

• Il SAP Global Support Center (GSC): è una unità interna a SAPB1 che supporta i partner quando essi non sono in grado di risol-vere un problema. Il partner in questo caso contatta il GSC perdiscutere la problematica incontrata dal cliente. Il GSC è diviso indifferenti sezioni (System, Finance, Logistic, ...) ognuna delle qualioffre supporto per differenti aree di B1. GSC offre supporto 24 x7. Le sedi GSC sono situate in Irlanda (sede principale), Israele,Slovacchia, Cina, India e Canada.

3

2. Analisi 4

• L’ Install Base Development (IBD): IBD è il dipartimento più inter-no che ha il compito di correggere bugs e malfunzionamenti. GSCfa usi di Internal Notes che spiegano come affrontare e risolvere pro-blematiche ricorrenti. Quando il GSC Consultant non è in gradodi risolvere una problematica o scopre o sospetta un nuovo bug,egli lo inoltra in IBD per una analisi più approfondita. Una voltache il problema è risolto esso viene ritornato indietro nella catenadall’IBD al GSC, al Partner SAP e fino al cliente finale.

Le interfacce sono di tipo 1-1 tra cliente finale e Partner SAP, PartnerSAP e GSC, GSC e IBD come illustrato in figura 2.1.

END CUSTOMER

SAP PARTNER GSC IBD

Figura 2.1: Business One Workflow

2.1.2 Overview Sistemi ed Entità

Nello schema di figura 2.2 sono presentati gli attori e i sistemi utiliz-zati. Più COMPANY-DB sono ripristinati sul medesimo TEC 1 server.Tutti i COMPANY-DB ripristinati sulla medesima istanza devono esse-re compatibili con l’SBO-COMMON di quella istanza. I server vengonomantenuti tramite le informazioni registrate nel database TEC Applica-tion Server. Il TEC Application Server è la base di informazioni perapplicativo TEC. I consulenti GSC e IBD utilizzano sia Customer Sup-port System New (CSN) 2 per il tracking del problema da risolvere cheTest Environment Center (TEC) per il download e restore dei databa-se dei clienti. I partner SAP hanno accesso esclusivamente al CSN perinserire messaggi e controllare lo stato di risoluzione.

2.1.3 Pratica Interna

Per meglio comprendere il resto della trattazione, vengono qui descritti iconcetti principali circa la struttura di SAP Business One di particolareimportanza per la definizione della base dati.

1TEC: acronimo di Test Environment Center, l’applicativo utilizzato per ri-pristinare i database inviati dai Partner SAP, effettuare upgrade e salvare ibackup.

2CSN: Applicativo usato da Parner SAP, GSC ed IBD per comunicare e seguirel’evolvere della soluzione al problema inoltrato dal partner. Tutte le comunicazioniufficiali, gli aggiornamenti, la proposta di soluzione e gli allegati vengono gestiti tramitetale applicativo.

5 Descrizione del Problema

COMPANY-DB

SBO-COMMON

COMPANY-DB

TEC Appication Server

TEC Server

TEC Server

TEC Application

CSN Application

GSC

IBD

Patch Level (PL)

Version (V)

Db Type

Patch Level (PL)

Version (V)

Db Type

FTP Server

DOWNLOAD & RESTORE

PARTNER SAP

CSN MessageTEC Ticket

GERMANY (WALLDORF) WORLDWIDE

Figura 2.2: Business One System OverviewLe frecce azzurre indicano gli applicativi utilizzati dall’IBD.Le frecce rosse indicano gli applicativi utilizzati dal GSC.

La freccia nera individua l’applicativo utilizzato dal partner SAP.

SAP Business One è un ERP per piccole medie aziende (fino a 100clients) con architettura client/server 2 tiers. Tale architettura usa il pre-sentation client per far eseguire la logica applicativa e si basa su un servercondiviso per il mantenimento dei dati. I database attualmente suppor-tati sono Microsoft SQL Server 2005 e IBM DB2. Versioni precedentieseguivano invece su SQL Server 2000 [3].

B1 si basa su due database:

• SBO-COMMON che contiene impostazioni di default e pacchetti diinstallazione per una certa versione di SAP B1.

• COMPANY-DB contenente i dati cliente.

Si noti che più COMPANY-DB possono condividere lo stesso SBO-COMMON.L’unico requisito è che la versione (V) e la Patch Level (PL) dei due siala medesima.

Una istanza di SAP B1 è completamente definita dalla versione, lapatch level e il tipo di database (SQL 2000, SQL 2005, DB2).

I GSC Consultant usano attualmente un applicativo chiamato CSNdove possono vedere i messaggi inseriti dai partner (ogni partner è iden-tificato da un identificativo). Dopo che il messaggio è stato inserito nel

2. Analisi 6

CSN esso può essere inoltrato da consulente a consulente allo stesso livello(ad esempio da un consulente GSC ad un altro consulente GSC) oppurepuò essere inoltrato ad un altro livello (verso l’interno: IBD, verso l’e-sterno: Partner). Il messaggio rappresenta il centro di tutto il sistema inquanto raccoglie tutte le informazioni relative al cliente (Customer ID,...), il Partner (Partner ID, ...), la versione di B1 (V, PL, DB type).

Quando il GSC Consultant comincia a risolvere un messaggio, egli hala possibilità di connettersi remotamente al partner o al cliente per ana-lizzare il problema. Nel caso in cui non sia possibile fornire una soluzioneda remoto, allora il partner deve trasferire il backup delCOMPANY-DB in una cartella SFTP assegnata dal consulente.

Una volta caricato il DB, il consulente GSC registra il messaggio nelTEC. TEC è un applicativo usato per importare i COMPANY-DB inviatidai partner nel corretto SAP server, dove i consulenti possono fare il logine risolvere i problemi che affettano la base dati.

Spesso si richiede (specialmente per i membri del System Team) di ese-guire determinate query nel database. Le informazioni relative al servere alla base dati a cui connettersi sono salvate in TEC.

2.1.4 Software Preesistente

I software attualmente in uso dal GSC sono:

• CSN (basato su SAP R3)

• TEC 3.0 (a breve sostituito da TEC 4.0 in sviluppo)

• Microsoft Sql Server Management Studio (MS SSMS)

è importante sottolineare che l’ambiente TEC è designato per supportaresolamente database MS Sql Server dato il numero elevato di installa-zioni, comparate a quelle di IBM Database2 DBMS (DB2). TEC 3.0 èattualmente basato su infrastruttura CITRIX-Metaframe [14].

Tutti i server MS Sql Server 2003 sono localizzati a Walldorf, in Ger-mania e sono accessibili globalmente tramite Virtual Private Network(VPN) da tutte le sedi B1.

2.2 Analisi del Problema

Il seguente capitolo presenterà solamente i moduli sviluppati. Per unadiscussione più generale si rimanda alla lettura di [2]

7 Analisi del Problema

2.2.1 Definizione del Problema

L’Azienda ha identificato i seguenti problemi, che dovevano essere rivistied analizzati:

• Rivedere l’implementazione di TEC, aggiungendo un modulo pereseguire e salvare query remote ed automatizzare operazioni ricor-renti da effettuare durante le operazioni di ripristino, upgrade ebackup delle base dati (moduli A e B).

• Migliorare la gestione della server farm, riducendo lo spazio occu-pato dai database dei clienti ed eliminando database residui nonpiù utilizzati (modulo C).

• Rivedere il processo di supporto interno fornito dal GSC SystemTeam al fine di migliorarne, se possibile, la produttività (modulo D).

SAP ha dato incarico al Project Manager di coordinare lo sviluppodel nuovo TEC 4.0 che andrà a sostituire la versione attualmente in uso.

La sezione seguente presenta i problemi affrontati, in coordinamentocon il Project Manager e gli altri sviluppatori. Nello specifico verrannodiscussi i seguenti moduli:

[MODULO A]

Esecuzione e salvataggio di query remote. Il problema attualmen-te evidenziato dai consulenti è l’assenza di una gestione automatizzatadelle query da eseguire. Ogni qualvolta il consulente GSC deve reperireinformazioni dalla base dati, egli deve ricorrere a Sql Server, selezionareil database su cui deve essere eseguita la query, ricordare la query daeseguire o selezionarne una da un repository, eseguirla e salvarne il risul-tato. Il risultato è tipicamente riportato a mano, copiato in un file excelo un’altra tabella temporanea.

[MODULO B]

Automazione di routine durante i processi di ripristino, upgradee backup della base dati. La versione attuale di TEC (3.0) non prevedealcun metodo per poter eseguire query preconfigurate. Ogni qual voltauno sviluppatore deve aggiungere, modificare o eliminare alcuni task, eglideve riscrivere nuovo codice o modificare il codice preesistente, toccandol’applicativo. Anche in questo caso si avverte la necessità di avere unrepository per le query da eseguire.

2. Analisi 8

[MODULO C]

Migliorare la gestione della server farm. Condurre una analisi alfine di rilevare le ragioni principali per cui TEC 3.0 fallisce, dove confallimento si intende che il Db non è stato correttamente ripristinato sullacorretta istanza e risulta quindi non accessibile da parte del consulenteGSC.

[MODULO D]

Migliorare il workflow aziendale. Analizzare il processo aziendaleinterno del GSC System Team ed evidenziare, se possibile, i workflow piùlenti proponendo ed implementando, una volta approvata, una possibilesoluzione.

2.3 Analisi dei Requisiti

In questo capitolo vengono descritti i vincoli di progetto specificati dalProject Manager, tenuti in considerazione durante la fase di progetto erealizzazione.

2.3.1 Vincoli di progetto

Le linee guida ivi specificate sono state discusse con Aurelien Leblond,Project Manager del progetto TEC 4.0

• L’ambiente di sviluppo da utilizzare deve essere Visual Studio

• Il linguaggio di programmazione deve essere C# in quanto il Teamdi sviluppo ha conoscenza pregressa con tale linguaggio

• Tutti i client girano su piattaforma Windows. Eventuali client nonNT potranno utilizzare l’applicativo tramite macchine virtuali VM-Ware [15] attualmente in fase di implementazione presso la sedecentrale di Walldorf, in Germania

• La base dati deve essere Sql Server 2005 per omogeneità con la basedati utilizzata da SAP Business One. E’ prevista una migrazionesuccessiva a Sql Server 2008.

• Data la necessità di concludere la prima release di TEC 4 entromarzo 2009 la progettazione e realizzazione dell’applicativo dovevaessere concluso entro gennaio 2009, concentrandosi sulle caratteri-stiche fondamentali del sistema invece che sul progetto di dettaglio,da effettuarsi in un secondo momento.

9 Analisi dei Requisiti

• Tutte le operazioni che comportano iterazioni con le basi dati deiclienti devono essere eseguite in un ambiente di test 3. Una vol-ta validate le funzionalità, queste possono essere implementate inTEC.

2.3.2 Casi d’uso

In figura 2.3 sono rappresentati i casi d’uso relativi ai moduli A, B, Cintrodotti nella sezione 2.2.1. Come si può vedere, vengono separate lefunzionalità riservate agli amministratori TEC (TECAdmin) dai consu-lenti (TEC User). Inoltre il TECAdmin risulta essere una specializzazionedel TEC User per cui può accedere a tutte le funzionalità di quest’ultimo(indicate dai punti 1,2,3) più altre a lui riservate (4,5,6). I casi d’usoindicati ai punti 1,5,6,8,9 sono quelli stabiliti come essenziali già nellaprima fase di realizzazione di progetto. I punti 2,3,4 sono quelli svilup-pati nell’ambiente di test, per il punto 7 è invece stata ultimata da partedi un altro sviluppatore la sezione relativa al restore.

uc Use Case Model

TEC

TECUser

1. Filter & View Result

2. Execute Query & Sav e Result

TECAdmin

6. Properties Framework

4. Backup Manager

3. Upgrade Manager

8. TEC Client

9. TEC Serv er

5. Query Admin

7. Upgrade, Backup, Restore

TEC Database

Serv er Farm

«extend»

«use»

«extend»

«extend»

«communicate»

«extend»

«extend»

«extend»

«communicate»

«use»

Figura 2.3: Use Case del Sistema

3Per l’ambiente di test si veda il progetto Visual Studio denominato RemoteQueries

2. Analisi 10

2.3.3 Planning delle attività

La fase di progettazione, descritta nel successivo Capitolo 3 inizia conlo sviluppo dei moduli A e B (in quanto il modulo B è stato inseritoall’interno del modulo A), seguito dal modulo C ed infine viene presentatala proposta di ridefinizione del sistema del modulo D.

Capitolo 3Progetto del Sistema

3.1 Moduli A e B: Generic Query

Nei paragrafi seguenti verranno descritte le fasi di progetto dei diversielementi che costituiscono i moduli A e B. In particolare verrà descrittoil canale di comunicazione tra client e server, il listener su server, la basedati, l’interfaccia PropertiesFramework, i plug-in Query Admin e QueryResult.

3.1.1 Il canale di comunicazione

Data la struttura Client Server di TEC era necessario individuare il meto-do di trasporto più opportuno per i dati che devono transitare nel canaledi comunicazione che permette il dialogo tra l’applicativo client ed il ser-ver remoto.Sono stati considerati i seguenti fattori

• Livello di trasporto da adottare

• Operazioni da svolgere in ingresso e in uscita dal canale

• Tipo di dati da fare transitare nel canale

Dato il vincolo relativo al linguaggio di programmazione e all’am-biente di sviluppo imposto dal Team Leader, la scelta è ricaduta in unaimplementazione con .NET Remoting.

Per quel che riguarda il livello di trasporto adottato, .NET Remotingsupporta i protocolli TCP, HTTP ed altri protocolli personalizzabili. Da-to che il contesto in cui opera il sistema è una VPN opportunamente con-figurata, si è scelto di implementare il sistema con Transmission ControlProtocol (TCP) e formattatore binario, fornito di default. Utilizzando

11

3. Progetto del Sistema 12

TCP invece che Hypertext Transfer Protocol (HTTP), si riduce la quan-tità di dati scambiati tra gli end-point data l’assenza degli header intro-dotti da HTTP nel payload TCP. Si è scelto di sviluppare Client e Serverin modo tale che sia comunque possibile cambiare il canale utilizzato (daTCP ad HTTP e viceversa) tramite file di configurazione.

Per i dati in transito si sono valutate le operazioni di compressione,formattazione binaria e crittografia. La formattazione binaria risulta in-dispensabile per poter trasferire i dati sul canale. La crittografia è statatrascurata in quanto tale servizio è offerto dalla VPN aziendale men-tre è stata implementata una compressione in ingresso\uscita al canale,considerata la scarsa capacità di serializzazione1 offerta da .NET.

Come evidenziato da Rammer in [17], viene suggerita l’implementa-zione di un sink di compressione qualora gli oggetti da trasferire conten-gano prevalentemente stringhe o testo. Se tale condizione è verificata sipuò arrivare ad una dimensione dell’oggetto serializzato\compresso infe-riore del 50% rispetto all’originale stream serializzato. Diverso è il casoin cui i dati da trasferire siano immagini o flussi audio\video nel qualcaso l’interfaccia di compressione deve essere implementata direttamentenel serializzatore con opportune codifiche di compressione (e.g. JPG perle immagini).

Oltre a questo, l’articolo di Schwarzkopf e Mathes [18] afferma a pa-gina 402 quanto segue: “[...] .NET seems to use a kind of UTF-8 forserialization of chars, which uses one, two or three bytes depending onthe character ”. Questa assunzione giustificherebbe l’uso di un compres-sore dato il buon livello che è possibile ottenere usando un opportunocompressore come evidenziato nell’articolo Compression of Unicode filesdi Fenwick e Brierley [12].

Nel caso in esame gli stream da trasferire contengono quasi esclusiva-mente stringhe e risultati di esecuzione, che giustificano l’implementazio-ne del sink di compressione.

In figura 3.1 vengono visualizzate le operazioni svolte dal canale eviene indicato dove dovrebbe essere inserito l’algoritmo di compressionein caso si volesse implementare in un secondo momento. Come si puònotare la compressione deve essere eseguita prima di criptare il messaggioin transito sul canale, altrimenti risulterebbe poco efficiente in termini dilivello di compressione.

Essendo .NET Remoting Object Oriented e quindi in grado di ge-stire oggetti, non sono stati specificati particolari requisiti circa il tipodi oggetti da scambiare. Saranno invece specificate alla sezione 4.1.2 lecaratteristiche di tali oggetti.

1Capacità di serializzazione intesa come dimensione in byte dello stream serializzatocompresso rispetto allo stream serializzato

13 Moduli A e B: Generic Query

CLIENT

CHANNEL

SERVER

CHANNELOBJs

Serializable Objects- Query- Result- Event

- Db Type

CHANNEL

COMPRESSION ENC.

OBJs

CHANNEL

COMPRESSIONENC.BINARY FORM. BINARY FORM.

pwdf6541TEC User

SAP VPN

TEC User

Figura 3.1: Channel

3.1.2 Il Server Listener

Scopo del Server Listener è quello di offrire servizi ai clients, gestendo leinformazioni in input ed in output con la base dati.

SERVER

CHANNEL

TEC DBLISTENER

Figura 3.2: Listener

Per poter dialogare con la base dati le possibilità erano o fornire unaccesso autonomo indipendente per ognuno dei servizi implementati dalListener oppure implementare un framework di comunicazione tra i serviziimplementati sul listener e la base dati.

La possibilità di poter usufruire di un accesso indipendente servizioper servizio permette allo sviluppatore di decidere in piena autonomiacome gestire le comunicazioni con la base dati, come ad esempio il timeoutdi connessione, la gestione delle transazioni, la modalità di accesso alletabelle. Questa autonomia si può comunque rilevare controproducente inquanto:

3. Progetto del Sistema 14

• Lo sviluppatore potrebbe non avere conoscenza relativa alla strut-tura dell’intera base dati

• Lo sviluppatore potrebbe focalizzarsi sulla sue operazioni senza va-lutare le eventuali implicazioni che questo può avere su operazioniconcorrenti svolte da altri sviluppatori

• Si rischia di introdurre ridondanza nel caso in cui uno sviluppatorenecessiti delle informazioni fornite da una certa vista, e non siaal corrente che tale funzionalità è già implementata in un serviziosviluppato da un altro programmatore

La seconda possibilità è invece l’utilizzo di un framework per l’accessoalla base dati: il framework conterrà un insieme predefinito di funziona-lità e nel caso in cui una funzionalità richiesta non sia presente, essadovrà essere notificata allo sviluppatore del framework. Sarà compito diquest’ultimo fornire il metodo di accesso nel modo più opportuno.

Questa soluzione toglie definitivamente allo sviluppatore del serviziola possibilità di accesso diretto alla base dati, dall’altro però garantiscela consistenza della base dati ed in caso di malfunzionamento o modifichesarà necessario intervenire unicamente sul framework invece di metteremano a tutti i servizi implementati dai diversi sviluppatori.

Si noti in figura 3.3 dove si è deciso di implementare l’interfacciaPropertiesFramework per l’accesso alla base dati.

SERVER

CHANNEL

TEC DBLISTENER FRAMEWORK

Figura 3.3: Properties Framework

3.1.3 La Base Dati

L’accesso alla base dati poteva essere implementato in 2 differenti modi. Idue modi di accesso verranno qui esposti e verrà data una giustificazionedella scelta effettuata.

Accesso con query definite nel codice

In questo caso lo script della query da eseguire è nidificato all’interno delcodice C# dell’interfaccia PropertiesFramework. Quando il programma-tore richiama una funzionalità in PropertiesFramework, l’implementazio-

15 Moduli A e B: Generic Query

ne dell’interfaccia stabilisce una connessione con la base dati ed inoltral’intera stringa contenente la query da eseguire.

Accesso con Stored Procedures

In questo caso nell’implementazione di PropertiesFramework viene speci-ficato solamente il nome della stored procedure esistente all’interno dellabase dati, che deve essere richiamata. Quando il programma richiamauna funzionalità in PropertiesFramework, l’implementazione stabilisceuna connessione con la base dati e richiama la Stored Procedure.

Durante la fase implementativa è stato scelto questo secondo approc-cio a seguito delle seguenti considerazioni:

• Modularità offerta dalle stored procedures: in caso di bug o modifi-che da eseguire sulla query in oggetto (o piu generalmente parlandodel batch da eseguire) risulta indubbiamente più semplice effettuareil debug della stored procedure su Sql Server piuttosto che analizza-re una stringa immersa nel codice C#. Oltretutto la nuova versionedi Sql Server 2008 offre un ambiente di debug contenente molte dellefunzionalità di debug presenti in Visual Studio. Data la retrocom-patibilità con basi dati Sql2005 offerta da Sql Server 2008, è orapossibile utilizzare l’ambiente di debug offerto da quest’ultimo perl’analisi e il debug delle stored procedures. stesse.

• è possibile effettuare il tuning delle stored procedures, utilizzan-do l’Execution Plan ed il Tuning Advisor integrati in Sql Server.Tramite questi programmi una stored procedure può essere rivistaed eventualmente modificata per diminuirne il tempo di esecuzio-ne (quando possibile). Tale operazione è del tutto trasparente al-l’interfaccia Properties Framework che quindi non richiede d’esseremodificata.

• Per quanto detto a inizio paragrafo, il traffico di rete viene ridot-to in quanto non è necessario passare a Sql Server l’intera stringacontenente la query ma solamente il nome della stored procedure.

• Maggiore interoperabilità: nel caso in cui insorga la necessità disviluppare applicativi in linguaggi differenti, basterà che questi ab-biano una interfaccia di accesso ai dati per Sql Server, per poterrichiamare le stored procedure preesistenti

• Il codice definito all’interno delle stored procedures viene analizzatodal parser di Sql Server e dopo la prima esecuzione verrà genera-ta una versione in-memory che verrà eseguita più velocemente airichiami successivi.

3. Progetto del Sistema 16

A fronte di questa discussione si devono tuttavia ricordare alcuni ca-si in cui l’implementazione di stored procedures all’interno del codicepossono offrire una valida alternativa, ossia quando:

• La query da eseguire viene generata a runtime

• I dati di ritorno di una stored procedure sono usati per creare unanuova stringa T-SQL.

Lo schema finale che ne deriva è quello mostrato in figura 3.4

SERVER

CHANNEL

TEC DB

FRAMEWORKVIEW

LIBRARYSTORED PROCEDURE

LIBRARY

TABLE

Figura 3.4: Modello di Accesso ai dati

Viste

Si è deciso di interfacciare le stored procedures con delle viste piuttostoche interfacciarle direttamente con le tabelle. Questa decisione è statapresa a seguito delle seguenti considerazioni:

• La vista consente di visualizzare tabelle e relazioni tra tabelle in unformato più conveniente

• Il tempo di accesso ai dati su una vista è esattamente lo stesso diaccesso diretto alle tabelle da cui la vista è stata ottenuta.

• Possono essere combinate con ruoli (che rappresentano diversi grup-pi di utenti) per consentire l’accesso esclusivo a tabelle e\o viste aseconda del ruolo assegnato all’utente.

• In caso di modifica alla tabella di origine, la vista può essere mo-dificata in modo tale da offrire la medesima interfaccia alle querye\o stored procedure che la utilizzano.

Lo svantaggio principale derivante dall’uso delle vista sta nel fatto che,in caso di modifica ad una determinata tabella, referenziata da viste

17 Moduli A e B: Generic Query

multiple, potrebbe essere necessario modificarle tutte per garantire ilfunzionamento delle stored procedures.

Nel caso in oggetto, date le molteplici stored procedure che si andran-no a sviluppare si è scelto di ricorrere all’uso delle viste

Schema

Un’altro concetto offerto da Sql Server che si è deciso di utilizzare è statoil concetto di schema.

Scopo dello schema è quello di separare gli oggetti sul database daidiritti utente. Lo schema può essere visto come una unità logica che rac-coglie più oggetti. Esso può essere utilizzato per diversi scopi [[6]] ma nelnostro caso si è scelto, in comune accordo con gli altri DBA di utilizzaregli schema per separare le varie aree del database.

Le aree proposte sono state:

• B1

• BackupManager

• Core

• Infrastructure

• Internal

• Properties

• Security

come evidenziato in figura 3.5.Per quanto sviluppato in questa Tesi, tabelle, viste, stored proce-

dures saranno tutte identificate dallo schema Properties e dallo schemaBackupManager.

Ridefinizione dei requisiti

I requisiti inerenti la base dati e riportati in Appendice A sono statireinterpretati e riassunti nelle tabelle 3.1, 3.2, 3.4 e 3.3. Entity e Eventsono qui omessi per non appesantire la trattazione.

Il Modello E-R che ne deriva è mostrato in figura 3.6

3. Progetto del Sistema 18

QUERYHA una descrizionePUO’ riferire ad una SAP notePUO’ essere pubblicaHA il testo della queryPUO’ avere un ordine di esecuzioneHA una data di modificaHA uno timestamp di modificaE’ ASSOCIATA ad un eventoE’ inserita da un TECAdminPUO’ produrre dei risultatiPUO’ essere eseguita su un solo specifico tipo di database

Tabella 3.1: Tabella Query

RESULTHA un risultato di esecuzioneE’ ASSOCIATO ad una queryE’ PRODOTTO da un utenteAPPARTIENE ad un ticketHA una data di modificaHA un timestamp di modificaPUO’ essere un risultato d’errore

Tabella 3.2: Tabella Result

BATCHHA un ID di esecuzioneHA uno StatoPUO’ generare nessuno, uno o più risultati

Tabella 3.3: Tabella Batch

19 Moduli A e B: Generic Query

class Db Schemas

Db Schemas

B1

Core

Infrastructure

Internal

Properties

Security

BackupManager

Figura 3.5: Schema definiti nel database TEC

3.1.4 L’interfaccia Properties Framework

In figura 3.7 sono rappresentati i servizi offerti dall’interfaccia Propertie-sFramework e le relazioni con le stored procedure della base dati. I serviziofferti sono di 3 tipi: Salvataggio, Esecuzione e Selezione. Le operazio-ni di modifica ed eliminazione non sono state prese in considerazione inquanto il Project Manager ha proposto di creare un Framework comu-ne a tutti gli schema per le operazioni di UPDATE, DELETE. Inoltre,data la disponibilità di un DBA, non ha senso provvedere allo sviluppodi operazioni INSERT, UPDATE e DELETE per entità quali ENTITYed EVENT. ENTITY ed EVENT infatti sono raramente modificati, RE-SULT è sempre aggiunto automaticamente e non ha senso una modificadel risultato di una query. L’operazione di DELETE non deve essereeffettuata da parte degli sviluppatori ma eseguita automaticamente nelcaso un messaggio CSN venga chiuso o il database sia stato eliminato (siveda la parte di implementazione per le riflessioni in merito).

3. Progetto del Sistema 20

RELAZIONIQUERY può generare zero o più RISULTATIRISULTATO può essere generato da una e una sola QUERYQUERY è inserita da uno ed un solo TECADMINTECADMIN può inserire zero o più QUERYQUERY può essere eseguita su una ed una sola ENTITàENTITA’ può essere oggetto di zero o più QUERYQUERY può generare un RISULTATO di erroreRISULTATO è output di una ESECUZIONETECUSER può eseguire una o più ESECUZIONIRISULTATO può appartenere a un BATCH di esecuzioneUn BATCH di esecuzione può generare uno o più risultatiUna QUERY può eseguire come BATCH

Tabella 3.4: Tabella Relazioni

Properties.Query GENERATE Properties.Reult

Security.TECUser

ADD

ON

Properties.Entity

EXECUTE

ResultID

ResultDateExecutionResult

1,1

0,N

1,10,N

0,N

1,1

QueryDescriptionSAPNoteIsPublic

QueryText

QueryID

0,N 1,1

EntityID

TECUserIDCore.Ticket

Description

RETRIEVE

RAISE

Properties.Event

EventIDDescription

0,N

0,1

TicketID

1,1

0,N

Properties.Batch BELONG

BREED

OWN Properties.Status

0,N

1,1

0,1

0,N

1,10,N StatusID

Description

BatchID

Figura 3.6: Modello E-R Schema Properties

21 Moduli A e B: Generic Query

WH

AT

TO

DO

EX

EC

UT

E A

Q

UE

RY

ALR

EA

DY

S

TO

RE

D O

N

DB

CH

EC

K

BE

FO

RE

S

AV

INGY

Get

Sav

edQ

uery

Res

ult

Y

TIM

E

CO

NS

UM

ING

Q

UE

RY

Exe

cute

And

Sav

eR

esul

tE

xecu

teA

ndS

ave

Res

ultA

sync

NG

etR

emot

eQue

ryR

esul

t

N

EX

EC

Lin

e

SA

VE

A Q

UE

RY

Sav

eQue

ry

SA

VE

A R

ES

ULT

Sav

eRes

ult

SA

VE

Lin

e

GE

T L

IST

OF

Q

UE

RY

GE

T L

IST

OF

R

ES

ULT

GE

T L

IST

OF

E

NT

ITIE

SG

ET

LIS

T O

F

EV

EN

TS

Get

Que

ryLi

stG

etQ

uery

Res

ult

List

Get

Ent

ityLi

stG

etE

vent

List

NY

GE

T A

SP

EC

IFIC

R

ES

ULT

Get

Sav

edR

esul

t

6

3

7

1

811

54

2

910

GE

T L

IST

OF

B

AT

CH

GE

T L

ine

Get

Bat

chLi

st

12

1 2 3 4 5 6

Set

Res

ult

Set

Que

ry

Get

Sav

edQ

uery

Res

ult

Get

Sav

edQ

uery

Res

ult,

Set

Res

ult

Get

Sav

edQ

uery

Res

ult,

Set

Res

ult

Get

Rem

oteQ

uery

Res

ult

7 8 9 10 11 12

Get

Que

ryLi

st

Get

Que

ryR

esul

tLis

t

Get

Ent

ityLi

st

Get

Eve

ntLi

st

Get

Res

ult

Get

Bat

ch

ST

OR

ED

PR

OC

ED

UR

ES

ST

OR

ED

PR

OC

ED

UR

ES

IPro

pert

iesF

ram

ewor

k

Figura

3.7:

ServiziO

ffertid

aPrope

rtiesFram

ework

3. Progetto del Sistema 22

3.2 Modulo C: Backup Manager

Riprendendo quanto esposto nella sezione 2.2.1, lo scopo del modulo diBackup Manager è quello di identificare il problema che porta la proce-dura di restore a fallire, compromettendo il funzionamento dell’ambienteTEC. L’ambiente TEC è composto di 15 servers, locati in Germania sulquale sono installate 75 istanze tra Sql2000, Sql2005 (La lista completadelle istanze è riportata in appendice).

L’impossibilità di ripristinare i database dipendeva dai seguenti mal-funzionamenti:

• userID e\o password dell’area Secure File Transfer Protocol (SFTP)non corretti

• backup non compresso e\o compresso in formato differente dai for-mati supportati (.zip e .rar)

• file compresso corrotto

• mismatch tra la versione del backup (e.g. Sql2005) e il server su cuieseguire il restore (e.g. Sql2000)

• versione di Business One non conforme alla versione dichiarata infase di richiesta del TEC Ticket, con conseguente mismatch tra ilCOMPANY-DB e l’SBO-COMMON

• fallimento della procedura di unzip a causa di mancanza di spaziosu server

• fallimento della procedura di restore a causa di mancanza di spaziosu server

• impossibilità di operare sulla base dati a causa della impossibilitàdi allocare spazio su server

Per poter identificare quali di questi problemi erano i più significativisono stati analizzati i messaggi IT inseriti in CSN dai consulenti SAP perrisolvere le problematiche incontrate durante l’utilizzo di TEC.

I consulenti hanno richiesto nell’arco di tre anni 3897 richieste di in-tervento da parte di un TECAdmin. Di tutti i TECAdmin (21 in totale)sono stati individuati quelli con il maggior numero di messaggi analiz-zati (8 TECAdmin) che da soli hanno provveduto a risolvere l’80% deimessaggi totali. Questi consulenti sono stati contattati per avere un lorofeedback circa le cause di malfunzionamento. Oltre ai feedback dei con-sulenti sono stati analizzati 20 messaggi scelti a campione per ognuno deiconsulenti individuati, per un totale di 160 messaggi analizzati.

23 Modulo C: Backup Manager

La verifica incrociata tra i feedback e i messaggi campione analiz-zati ha portato all’individuazione della causa principale per cui l’ope-razione di restore dei database falliva ossia la mancanza di spazio suserver. Tale situazione è stata rilevata eseguendo un analisi dei Db (siveda lo script Analysis.sql e la tabella [snapshot].[RequiredDatabase] neldatabase TEC).

Come si vede dal trend del grafico sottostante, il numero di databaseripristinati sui server è andato via via aumentando, mese dopo mese. Idatabase vengono eliminate automaticamente quando non utilizzati perpiù di 14 giorni, questo giustifica l’andamento discendente in alcuni punti.

Figura 3.8: Numero database ripristinati su server

Il secondo grafico mostra invece il totale annuo di database ripristinatisu server. Si noti che per l’anno 2006 e 2009 i dati sono stati previsti datoche nel 2006 l’uso di TEC è iniziato a dicembre e nel 2009 I dati sonostati raccolti a metà febbraio.

Figura 3.9: Totale spazio annualmente allocato sui server

Le previsioni per il 2009 sono ottimistiche e non tengono conto di

3. Progetto del Sistema 24

possibili flessi dovuti alle minori richieste di supporto data l’attuale si-tuazione economica a livello mondiale.

Sulla base di tali considerazioni è quindi necessario ottimizzare l’u-tilizzo delle risorse a disposizione invece di fare investimenti economicipuntando sull’acquisto di hardware dedicato (sempre che questo vengaautorizzato dalla dirigenza).

3.2.1 La Procedura di Restore attuale

Quando il consulente necessita di ripristinare un database compila il formdi figura 3.10, immettendo il message number del messaggio CSN, il cu-stomer number, la versione di Business One, il tipo di Server e i parametridi accesso all’area SFTP. L’applicativo determina, in base ad una logi-ca interna 2 il server sul quale deve essere fatto il download del databasecompresso in formato .zip o .rar . Verrà quindi create una cartella nel net-work path \ \ServerName \backups$\Data ed ivi verrà creata una cartel-la nel formato Anno_CSNMessageNr_CSNCustomerNr_TECTicketNr.In questa cartella verrà riposto il database, esso verrà estratto nella sot-tocartella tmpTEC, ripristinato su server con nomeAnno_CSNMessageNr_CSNCustomerNr_TECTicketNr e la cartella tmp-TEC verrà immediatamente eliminata. Dopo 14 giorni di inutilizzo deldatabase sia la cartella che il database con nomeAnno_CSNMessageNr_CSNCustomerNr_TECTicketNr verranno elimi-nati 3.

3.2.2 Problemi Rilevati

A seguito delle interviste condotte con gli sviluppatori del modulo TECpreposto all’operazione citata nel paragrafo precedente, le possibili causedi spreco di spazio sono:

• creazione da parte dei TECAdmin di cartelle che non corrispondonoa nessun database a seguito di restore manuale.

• estrazione manuale e dimenticanza del file scompattato .bak nelladirectory tmpTEC

• ripristino di database sui server senza seguire le regole di nomen-clatura sopracitata

2Per determinare l’istanza corretta viene comparata la versione, la patch level e iltipo di database dichiarato dal consulente al momento della richiesta del messaggio.Una volta determinata l’istanza corretta, viene scelto tra tutti i server con l’istanzarichiesta, quello con spazio maggiormente libero.

3La procedura di restore per òa versione TEC 4.0 ripristina il databasecon nome TECTicketNr per il COMPANY-DB e TECTicketNr_COM___ perl’SBO-COMMON.

25 Modulo C: Backup Manager

Figura 3.10: TEC 3 - GUI Richiesta ticket

3. Progetto del Sistema 26

• mismatch tra la nomenclatura della cartella e il database ripristi-nato.

I database, una volta ripristinati vengono o utilizzati dai consulenti o neviene fatto un upgrade: Tutte le transizioni eseguite nel database vengonosalvate nel Transaction Log. Il Transaction Log risulta essenziale in casodi rollback ad una situazione precedente ma risulta controproducentenel caso in analisi in quanto va ad aumentare drasticamente lo spaziooccupato dal database, specie a seguito di una operazione di upgrade.Per una trattazione più esauriente si rimanda a [5].

3.2.3 Possibili Soluzioni

I problemi rilevati possono essere risolti con le seguenti operazioni:

• eliminazione delle cartelle su server non conformi al formatoAnno_CSNMessageNr_CSNCustomerNr_TECTicketNr

• eliminazione dei database non conformi al formatoAnno_CSNMessageNr_CSNCustomerNr_TECTicketNr

• shrink di tutti i database presenti su server

Prima di poter procedure con tale implementazione deve essere valu-tato se vale la pena sviluppare un software appositamente per tali attivitào se piuttosto conviene pulire manualmente i server. Il tempo necessarioalla verifica deve essere limitato rispetto al tempo necessario a svilupparel’eventuale software.

Si è deciso di utilizzare il software SequoiaView [19], sviluppato dal-l’Università Tecnica di Eindhoven per verificare lo stato dei server.

è stato creato uno ColorScheme (si veda il file SequoiaTecColors.txt)con la mappa colori. Un tipico screenshot è rappresentato in figura 3.11

Come si può notare la situazione è critica in quanto file di backup(rosso) occupano una grossa percentuale dello spazio su hard disk. Ana-logamente alcuni database hanno file .mdf (blu) e file .ldf (viola) piuttostoestesi a causa della mancata operazione di shrink.

Per quanto detto si è deciso di sviluppare:

• un applicativo per la rilevazione delle cartelle con mismatch

• uno script per eseguire lo shrink distribuito sui server, da imple-mentare come Job su Sql Server

In figura 3.12 è riportato lo schema di funzionamento dell’applicativoBackupManager, la cui implementazione è descritta nel capitolo 4.

27 Modulo D: Ridefinizione GSC Workflow

Figura 3.11: Snapshot Sequoia

3.2.4 Schema E-R Backup Manager

Il modello E-R relativo allo schema BackupManager è rappresentato infigura 3.13.

In questo caso la struttura della base dati è piuttosto semplice inquanto sono immediatamente distinguibili tre entità: Server, Directory eFile. Un server può contenere più directory ed una directory può conte-nere più file. Analizzando in senso opposto si ha invece che un file puòessere contenuto in una ed una sola directory ed una directory può esserecontenuta in uno ed un solo server. Come si vede dal modello-ER vengonoomesse tutte le informazioni non pertinenti (come ad esempio eventualisottocartelle), questo perché lo scopo è quello di identificare cartelle conpiù di un file (che dovrebbe essere il file compresso contenente il backupdel database) e cartelle orfane (ossia non associate a nessun ticket).

3.3 Modulo D: Ridefinizione GSC Workflow

Lo schema rappresentato in figura 3.14 riassume il workflow attualmentein uso.

Quando un consulente (FI, LOG, AP\AR...) analizza un messaggiopuò essere necessario richiedere un upgrade. In tal caso la richiesta vieneelaborata dall’ambiente TEC e quindi eseguita. Una volta ultimato ilprocesso di upgrade il consulente viene notificato sull’esito positivo o me-no dell’upgrade. In caso l’esito sia negativo, il consulente deve contattareun membro del System Team e notificare il fallimento dell’upgrade.

3. Progetto del Sistema 28

Pwdf2660

BackendRootList

BackendServer

Directory

File

GetBackendRootList

ServerManagerServerManagerSetServer

SetDirectory

SetFile

RestoredDatabase

BackupManager SCHEMA

COLLECT DATA

STORE DATA

TEC_LIVE

DistributedShrink_V2.sql(STEP 4)

1.

1. Executed when the application starts2. Executed when the button “COLLECT DATA” is pressed3. Executed when the button “STORE DATA” is pressed4. Executed on Step 4 in DistributedShrink_V2.sql

3.

4.

ServerManager()

2.

Figura 3.12: Overview Backup Manager

Il System Consultant a questo punto analizza il database di partenzaper determinare la causa che ha impedito l’upgrade, determina quindi ilfix da applicare e reinoltra la richiesta di upgrade. A questo punto egliotterrà l’esito dell’upgrade. Se positivo, potrà notificare a sua volta l’esitoal consulente GSC che ha inoltrato la richiesta, altrimenti deve reiterare ilprocesso di analisi\fix fino a quando la procedura non va a buon fine. Unavolta che il consulente riceve notifica di avvenuto upgrade, può continuarecon la sua attività di analisi sul database in oggetto e portare a terminel’attività di message processing.

Si noti che l’attività del General Consultant è non bloccante in quan-to nel momento in cui l’attività di restore solving viene delegata ad unmembro del System Team, egli può proseguire con l’analisi di un nuovomessaggio. L’attività del System Consultant è invece bloccante in quan-to egli tiene in carico il database sintantoche la procedura di upgradecontinua a fallire. Le attività più dispendiose sono appunto quelle dianalisi e problem solving. Oltretutto allo stato attuale vi sono solamen-te un paio di note SAP atte a rilevare possibili cause di upgrade failure(questo comporta che il System Consultant debba comunque interveniremanualmente per applicare il fix).

L’idea di sviluppo è quella di automatizzare, per quanto possibile,le attività di failure analysis e problem solving, spostandole all’internodell’ambiente TEC in modo tale da utilizzare il meno possibile i consu-lenti per la risoluzione di problemi interni. La soluzione proposta è quel-

29 Modulo D: Ridefinizione GSC Workflow

DirectoryIDName

0,N

DIRECTORY

FILE

BACKEND SERVER

TO HOLD

TO HOLD

1,1

0,N

1,1

CreationTimeLastAccessTime

NumFiles

BackendIDServernameBackupRoot

FileIDNameType

Figura 3.13: Modello E-R Schema BackupManager

la di utilizzare la struttura messa a disposizione dalle query generichesviluppate nel MODULO A.

L’idea di ridefinizione del workflow è illustrata in figura 3.15. In que-sto nuovo schema è stato aggiunto il processo denominato Forced Upgradeallo scopo di modificare il database rendendolo compatibile con la pro-cedura di upgrade. Tale processo si trova all’interno dell’ambiente TECe non richiede quindi alcun dispendio di tempo da parte dei consulenti.Solo nel caso in cui tale procedura fallisca, il database sarà analizzato daun System Consultant. Lo scopo è quello di potenziare il più possibiletale processo, riducendo gli interventi del System Team. Per fare questoogni qual volta una procedura di upgrade fallisce, il System Consultantvaluta se questo è dovuto ad un problema specifico della base dati delcliente (ad esempio una User Defined Table (UDT) aggiunta o un UserDefined Field (UDF) settato in modo non conforme alle specifiche SAP)o è un problema generale (tipicamente modifiche alle tabelle di sistemaSAP: modifica lunghezza campi nelle System Table). In questo secondocaso la procedura potrebbe essere automatizzata. L’effettiva implementa-zione viene valutata dall’Upgrade Solution Desk (USD) (attore aggiuntoche deve essere definito) tramite il processo di Issue Knowledge Transfer.I dettagli relativi alle procedure sono riportati nella sezione 4.3.

3. Progetto del Sistema 30

act Workflow

GENERAL CONSULTANT TEC ENVIRONMENTSYSTEM CONSULTANT

UPGRADE

End MessageProcessing

CONSULTING

MessageProcessing

Upg?

UPG. NOTIFICATION

Failure?UPG. FAILURE

ANALYSIS

PROBLEM SOLVING

UPG. NOTIFICATION

Upg?

POST FIX UPGRADE

UPG. NOTIFICATION

PICK A NEW MESSAGE

MESSAGE SOLVING

GO TO Consulting

GO TO Pick a new message

Y

Y

N

Y

N

Figura 3.14: Workflow Attuale

31 Modulo D: Ridefinizione GSC Workflow

act Workflow

UPG. SOLUTION DESKTEC ENVIRONMENTSYSTEM CONSULTANTGENERAL CONSULTANT

UPGRADE

End MessageProcessing

CONSULTING

MessageProcessing

Upg?

UPG. NOTIFICATION

Failure?

UPG. FAILURE ANALYSIS

PROBLEM SOLVING

UPG. NOTIFICATION

Upg?

POST FIX UPGRADE

UPG. NOTIFICATION

MESSAGE SOLVING

PICK A NEW MESSAGE

FORCED UPGRADE

UPGRADE NOTIFICATION

Failure?

GO TO Message Solving

Recurrent?

UPG. ISSUEKNOWLEDGE

TRANSFER

GO TO Pick a new msg

GO TO Pick a new message

Y

Y

N

N

N

N

Y

Y

Y

Figura 3.15: Workflow Ridefinito

Capitolo 4Implementazione

4.1 Moduli A e B

4.1.1 Properties Framework

L’interfaccia IPropertiesFramework e la sua implementazione è mostratain figura 4.1.

I parametri in input ai metodi sono tutti di tipo primitivo, per omo-geneità con la base dati cui i parametri verranno passati. I risultati inoutput sono tipi primitivi, DataSet e DataTable. Per poter essere utiliz-zati in modo opportuno, il programmatore deve essere a conoscenza dellastruttura dei DataSet e dei DataTable tornati dall’interfaccia.

In particolare i DataSet sono sempre tornati in seguito all’esecuzionedi una query, i DataTable sono invece tornati ogni qual volta vengonoacquisiti dati (siano essi relativi a Query, Result, Batch, ...) dalla basedati.

Particolare attenzione è stata posta nel metodo ExecuteAndSaveRe-sultAsync. Questo metodo riceve come parametri di ingresso il QueryIDdella query da eseguire, il ticketID sul quale la query deve essere eseguitae il TECUSerID dell’utente che sta effettuando l’operazione. Tale metododeve eseguire in modalità asincrona per non bloccare l’applicativo client.

Le possibilità analizzate sono state l’uso di un pool di thread e i threadmultipli.

In particolare sono state evidenziate le seguenti informazioni:

• Non ci sono priorità differenti tra thread diversi

• Il thread può eseguire per un tempo relativamente lungo ma l’ela-borazione vera e propria (l’esecuzione della query) viene eseguita inun server diverso da quello dove il thread viene creato ovverosia nelserver dove è fisicamente allocato il database target della query.

33

4. Implementazione 34

• Non è richiesto che i thread siano identificabili. Un thread vieneeseguito e muore senza notificare la fine dell’elaborazione al clientchiamante.

• Deve essere eventualmente possibile impostare il numero massimodi thread in esecuzione, dato che le risorse sui server non devonosolamente essere dedicate all’esecuzione di query.

La classe che meglio rappresenta questa situazione è la classe Thread-Pool che utilizza un pool di thread [11]. Il ThreadPool non è stato usatodirettamente, ma tramite l’uso dei delegati, come mostrato nel frammentodi codice qui riportato:

1 // delegate for method ExecuteAndSaveResult2 public delegate bool DelegExecuteAndSaveResult(int?

queryID, int? ticketID, int? TECUserID, int? batchID);3

4 // Delegate of type5 DelegExecuteAndSaveResult delegateExecuteAndSaveResult;6

7 [...]8

9 public int ExecuteAndSaveResultAsync(int? queryID, int?ticketID, int? TECUserID)

10 {11 int batchID = GetBatch(queryID, ticketID);12 delegateExecuteAndSaveResult =

ExecuteAndSaveResult;13 delegateExecuteAndSaveResult.BeginInvoke(

queryID, ticketID, TECUserID, batchID,null, null);

14 return batchID;15 }

Viene creato un delegato con la stessa firma (parametri e valori diritorno) del metodo che esegue in modalità sincrona. Il metodo asincro-no acquisisce dalla base dati l’ID del batch che deve essere eseguito. Ildelegato viene inizializzato e viene eseguito il metodo BeginInvoke che fapartire l’esecuzione asincrona del metodo ExecuteAndSaveResult. Il bat-chID identificante la query in esecuzione viene immediatamente tornatoal chiamante.

4.1.2 Gli oggetti serializzabili

Una volta stabilite le funzionalità che l’interfaccia PropertiesFrameworkè in grado di offrire (Sez. 3.1.4), si devono definire quali oggetti devonoessere creati e trasferiti (mediante serializzazione) al client remoto.

35 Moduli A e B

class Class Model

PropertiesFrameworkImpl

- delegateExecuteAndSaveResult: DelegateExecuteAndSaveResult

+ DelegateExecuteAndSaveResult(int?, int?, int?, int?) : bool+ ExecuteAndSaveResult(int?, int?, int?, int?) : bool+ ExecuteAndSaveResultAsync(int?, int?, int?) : int- GetBatch() : int+ GetEntityList() : DataTable+ GetEventList() : DataTable+ GetQueryList(bool) : DataTable+ GetQueryResultList(int?) : DataTable+ GetRemoteQueryResult(int?, string, int?) : DataSet+ GetSavedQueryResult(int?, int?) : DataSet+ GetSavedResult(int?) : DataTable- SaveErrorResult(int?, int?, int?, string, int?) : bool+ SaveQuery(string, int?, int?, string, bool?, int?, int?, int?) : int+ SaveResult(int?, int?, int?, DataSet, int?) : bool

«interface»

IPropertiesFramework

+ ExecuteAndSaveResult(int?, int?, int?, int?) : bool+ ExecuteAndSaveResultAsync(int?, int?, int?) : int+ GetEntityList() : DataTable+ GetEventList() : DataTable+ GetQueryList(bool) : DataTable+ GetQueryResultList(int?) : DataTable+ GetRemoteQueryResult(int?, string, int?) : DataSet+ GetSavedQueryResult(int?, int?) : DataSet+ GetSavedResult(int?) : DataTable+ SaveQuery(string, int?, int?, string, bool?, int?, int?, int?) : int+ SaveResult(int?, int?, int?, DataSet, int?) : bool

Figura 4.1: Interfaccia PropertiesFramework e sua implementazione

In tal caso si può fare riferimento alla struttura database creata, chefornisce utili informazioni circa la struttura degli oggetti:

• un Risultato è sempre associato ad una Query

• Una Query ha sempre associata una Entity ed un Evento

Quindi una valida rappresentazione è fornita da un oggetto Risultatoche contiene un oggetto Query. A sua volta l’oggetto Query contienel’oggetto Entity e l’oggetto Evento.

Analogamente si potrebbe definire che Entity contiene una lista dioggetti Query, Event contiene una lista di oggetti Query e Query con-tiene una lista di Results. Non si deve però dimenticare che tali oggettidevono essere scambiati all’interno di una rete WAN e la lista può poten-zialmente contenere una elevata quantità di dati. Questo influenzerebbenegativamente il server ove è in esecuzione il listener, a causa della mag-gior computazione necessaria per generare gli oggetti summenzionati e larete, per il maggior traffico dati generato. Ricordiamo inoltre, che quan-do si opera in una WAN una delle problematiche più importanti di cuisi deve tener conto è la latenza. In questo caso l’obiettivo è quello diridurre le chiamate cross-network trasferendo la maggior quantità di datipossibili ma necessari, in un singolo network round trip.

4. Implementazione 36

Il mancato uso delle liste negli oggetti costringe l’applicativo client adover gestire le relazioni tra gli oggetti. Per offrire un maggior supporto atali operazioni si è deciso di implementare due ulteriori metodi all’internodell’oggetto Result. Tali metodi sono List<Result> GetAll(Ticket ticket)e List<Result> GetAll(Query query, Ticket ticket).

Il primo metodo consente di reperire da server la lista di risultati diun particolare ticket, il secondo metodo invece ritorna la lista di risultatidi un particolare ticket associati all’esecuzione di una specifica query. Danotare che l’implementazione di tali metodi non deve caricare il datatablerelativo ad ogni risultato. Il datatable verrà tornato al client solamentea seguito dell’esecuzione del metodo ExecutionResult.

Il diagramma delle classi che ne deriva, per le considerazioni fatte, èriportato in figura 4.2.

4.1.3 Server Listener

In questo paragrafo verrà descritto come si è scelto di implementare ilServerListener su server.

.NET Remoting infatti offre diverse possibilità di attivazione deglioggetti remoti:

• Server Activated Object (SAO)

• Client Activated Object (CAO)

SAO: prima che un metodo remoto sia invocato su un oggetto remoto,l’oggetto deve esistere o essere creato. SAObjects vengono creati quantoil client invoca la prima chiamata a metodo remoto.

SAO a sua volta ha due metodi di registrazione: Singleton e Single-Call. Singleton viene istanziato una sola volta e serve tutte le chiamateda parte dei clients in maniera multithread. Oggetti Singlecall vengonoinvece creati ogni qual volta un metodo remoto viene invocato in questotipo di oggetti. L’oggetto singlecall ha un tempo di vita assai limitato inquanto vive per il tempo necessario a processare la chiamata del client esono quindi adatti per istanziare oggetti che non necessitano di uno stato.

CAO: Sono creati sul server immediatamente alla richiesta del client.Un’istanza di un oggetto CAO è creata ogni qual volta un client ne istan-zia una ed il tempo di vita è controllato dal client. La logica dei metodiCAO viene gestita nel proxy del client.

Le informazioni riportate sono le minime essenziali per comprenderela scelta di implementazione. Per una descrizione più esaustiva si rimandaa [17]

37 Moduli A e B

class SerializableObjects

IEquatable

Entity

- e_description: string- e_ID: int

+ Add(Entity) : Entity+ Delete(Entity) : void+ Entity(int, string)+ Equals(Entity) : bool+ GetAll() : List<Entity>+ ToString() : string+ Update(Entity) : Entity

«property»+ Description() : string+ ID() : int

IEquatable

Ev ent

- e_ID: int- e_name: string

+ Add() : Event+ Delete() : void+ Equals(Event) : bool+ Event(int, string)+ GetAl l() : List<Event>+ ToString() : string+ Update() : Event

«property»+ EventID() : int?+ Name() : string

IEquatable

Query

- q_Entity: Entity- q_Event: Event- q_ID: int?- q_IsPublic: bool- q_Order: int?- q_SAPNote: int?- q_TECUserID: int?- q_Text: string- q_timestampChg: byte ([])- q_Title: string

+ Add() : Query+ Delete() : void+ Equals(Query) : bool+ Get(string) : Query+ GetAll() : List<Query>+ GetAll(Event) : List<Query>+ GetByKey(int?) : Query+ Query(int, string, int?, bool, int?, string, int?, byte[], Event, Entity)+ Query(string, int?, bool, int?, string, int?, Event, Enti ty)+ ToString() : string+ Update() : Query

«property»+ Entity() : Entity+ Event() : Event+ ID() : int?+ IsPublic() : bool+ Order() : int?+ SAPNote() : int?+ TECUserID() : int?+ Text() : string+ TimeStamp() : byte[]+ Title() : string

IEquatable

Result

- r_batchID: int- r_dateTime: DateTime- r_executionResult: DataTable- r_ID: int- r_query: Query- r_TECUserID: int- r_timeStamp: byte ([])

+ Equals(Result) : bool+ ExecuteAndSaveResult(Query, Ticket) : void+ ExecuteAndSaveResultAsync(Query, Ticket) : void+ GetAll(Ticket) : List<Result>+ GetAll(Query, Ticket) : List<Result>+ GetByKey(int) : Result+ GetQueryResultList(Ticket) : DataTable+ GetResult(Query, Ticket) : DataSet+ GetSavedQueryResult(Query, Ticket) : DataSet+ Result(int, Query, int, byte[], DateTime, int)+ Result(int, Query, int, byte[], DateTime, DataTable)+ ToString() : string

«property»+ BatchID() : int+ DateTime() : DateTime+ ExecutionResult() : DataTable+ ID() : int+ Query() : Query+ TECUserID() : int+ TimeStamp() : byte[]

-r_query

-q_Event-q_Entity

Figura 4.2: Oggetti Serializzabili

4. Implementazione 38

Avere la logica sul client non garantisce che l’applicativo utilizzi sem-pre la versione più aggiornata dei metodi e in caso di aggiornamento deimetodi sul server è necessario provvedere a riavviare gli applicativi clientonde evitare comportamenti indesiderati. Questo esclude la possibilità diutilizzare gli oggetti di tipo CAO. Riguardo gli oggetti SAO, dato che sivogliono fornire servizi indipendenti ai diversi client ed essi non devonocondividere uno stato comune, si è scartata anche la possibilità di uti-lizzare gli oggetti di tipo Singleton. La scelta finale ricade dunque neglioggetti SAO SingleCall.

Il Listener sarà composto da una unica classe Listener, che conterràl’elenco di tutti gli oggetti SAO SingleCall richiamabili dagli applicativiclient. Ognuno di tali oggetti implementerà l’interfaccia per consentire lechiamate remote da client. La struttura base del listener è riportata inappendice C.

In questa tesi sono state sviluppate, oltre al listener, le classi QueryLo-cal che implementa l’interfaccia IQuery, EventLocal che implementa l’in-terfaccia IEvent, ResultLocal che implementa l’interfaccia IResultAdmin,EntityLocal che implementa l’interfaccia IEntity.

L’interfaccia IQuery permette le operazioni di aggiunta, modifica edeliminazione di una query su database. Essa permette inoltre di ritornareun oggetto serializzabile Query al client. L’interfaccia IEvent permette diaggiungere, modificare ed eliminare un evento su database. Essa inoltrepermette di ritornare una lista di oggetti serializzabili Event al client.L’interfaccia IEntity permette di aggiungere modificare ed eliminare unentità su database. Essa inoltre permette di ritornare una lista di oggettiserializzabili Entity al client.

L’interfaccia IResultAdmin estende l’interfaccia IResult. IResult con-sente di ritornare al client un oggetto Result cercandolo per ID, ritornareuna lista di Result fornendo alcuni parametri di ricerca, ritornare il da-tatable che rappresenta il risultato, eseguire una certa query e salvare ilrisultato.

Gli altri servizi offerti dal Listener, non essendo stati sviluppati dal-l’autore, non trovano trattazione nel seguito.

Le classi QueryLocal, EventLocal, ResultLocal e EntityLocal istan-ziano al momento della creazione, l’oggetto che implementa l’interfacciaIPropertiesFramework per l’iterazione con il database.

4.1.4 Schema Logico Database (Schema Properties)

4.1.5 Stored Procedures

Le stored procedure atte all’esecuzione delle query remote sono statesviluppate in modo modulare, partendo dall’interfaccia PropertiesFra-

39 Moduli A e B

class Project

MarshalByRefObject

PropertiesFramework::EntityLocal

- propertiesFwkHandler: IPropertiesFramework

MarshalByRefObject

PropertiesFramework::Ev entLocal

- propertiesFwkHandler: IPropertiesFramework

«interface»

PropertiesFramework::IPropertiesFramework

+ ExecuteAndSaveResult(int?, int?, int?, int?) : bool+ ExecuteAndSaveResultAsync(int?, int?, int?) : int+ GetEnti tyList() : DataTable+ GetEventList() : DataTable+ GetQueryList(bool) : DataTable+ GetQueryResultList(int?) : DataTable+ GetRemoteQueryResult(int?, string, int?) : DataSet+ GetSavedQueryResult(int?, int?) : DataSet+ GetSavedResult(int?) : DataTable+ SaveQuery(string, int?, int?, string, bool?, int?, int?, int?) : int+ SaveResult(int?, int?, int?, DataSet, int?) : bool

PropertiesFramework::PropertiesFrameworkImpl

MarshalByRefObject

PropertiesFramework::QueryLocal

- propertiesFwkHandler: IPropertiesFramework

MarshalByRefObject

PropertiesFramework::ResultLocal

- resultHandler: IPropertiesFramework

«interface»

TEC::IEntity

+ Add(Entity) : Entity+ Delete(Entity) : void+ GetAl l() : List<Entity>+ Update(Enti ty) : Entity

«interface»

TEC::IQuery

+ Add(Query) : Query+ Delete(Query) : void+ Get(string) : Query+ GetAl l() : List<Query>+ GetAl l(Event) : List<Query>+ GetByKey(int?) : Query+ Update(Query) : Query

«interface»

TEC::IResult

+ ExecuteAndSaveResult(Query, Ticket) : bool+ ExecuteAndSaveResultAsync(Query, Ticket) : void+ GetAll(int?) : List<Result>+ GetAll(Query, int?) : List<Result>+ GetByKey(int?) : Result+ GetQueryResultList(Ticket) : DataTable+ GetResult(Query, Ticket) : DataSet+ GetSavedQueryResult(Query, Ticket) : DataSet

«interface»

TEC::IResultAdmin

+ Add(Result) : Result+ Delete(Result) : Result+ Update(Result) : Result

«interface»

TEC::IEvent

+ Add(Event) : Event+ Delete(Event) : void+ GetAll() : List<Event>+ Update(Event) : Event

-resultHandler-propertiesFwkHandler-propertiesFwkHandler

-propertiesFwkHandler

Figura 4.3: Servizi offerti dal Server Listener

4. Implementazione 40

Ticket

PK TicketID

FK_CompanyBackupID FK_CompanyDatabaseID FK_TicketStatus TicketStatusDateFK1 FK_OwnerID TicketCreationDate TimestampChgU1 ComputCol TimestampDate

Result

PK ResultID

FK3 FK_QueryIDFK4 FK_TECUserID ExecutionResultFK1 FK_TicketID TimestampChg TimestampDateFK2 FK_BatchID Error

Batch

PK BatchID

FK3 FK_StatusID RequestTimeFK2 FK_QueryIDFK1 FK_TicketID

Status

PK StatusID

Description

TECUser

PK TECUserID

U1 NTUserName FirstName LastName EMail LastLoginDate FK_DepartmentID Active TimestampChg TimestampDate

Entity

PK EntityID

Description

Event

PK EventID

Description

Query

PK QueryID

U1 QueryDescriptionFK1 FK_EntityID SAPNote IsPublicFK3 FK_TECUserID QueryTextFK2 FK_EventID QueryOrder TimestampChg TimestampDate

Figura 4.4: Schema Logico DB (Schema Properties)

mework e sviluppando i moduli sottostanti.Data la necessità di eseguire query non note a priori, con result set non

noto a priori e con server\istanze che possono cambiare dinamicamente,si è fatto uso di Dynamic Sql. A fronte di una maggiore flessibilità glisvantaggi maggiori sono il problema di SQL injection e l’uso di EXEC()per query pass-through che non possono essere ottimizzate dal query plan.

Il problema di SQLInjection non rientra nei presupposti di utilizzo,in quanto i consulenti hanno comunque accesso a SSMS. Le query sonosempre e comunque manipolate da utenti con il dovuto training per l’u-tilizzo delle medesime. Non utilizzare il DynamicSql significa comunquedover spostare parte della logica all’esterno del database (ad esempio incodice di alto livello C#). Questo non aumenta la velocità di esecuzioneed inoltre costringe a gestire le transazioni dall’esterno del database. Lestored procedure più significative per lo sviluppo del MODULO A sonoqui riportate.

[Properties].[LinkedServerConn]

La stored procedure [Properties].[LinkedServerConn] crea una connessio-ne tramite linked server al database remoto selezionato sulla base dei pa-rametri in ingresso e ritorna il nome stesso del linked server. I parametridi ingresso sono:

• @intTicketID: identificativo del TEC Ticket

• @strHost: backend server

41 Moduli A e B

• @strInstance: backend instance

• @intEntityID: stabilisce se la connessione deve essere al Compa-nyDb o all’ Sbo-Common

NOTA: In caso venga aggiunto un nuovo tipo di database (detto En-tity nella SP) e sia necessario eseguire delle query su di esso, allora deveessere aggiunto nei due statement SELECT la signature del linked servere del nome del database

Si può osservare come sono stati nominati i Linked Server per:

• CompanyDb: HOST_INSTANCE_TICKETID

• SBOCommon: HOST_INSTANCE_TICKETID_COM___

La stored procedure, una volta determinato il percorso al linked ser-ver, verifica se questo è già presente nella tabella master.sys.sysservers(tabella ove vengono memorizzate tutte le connessioni a Db remoti). Nelcaso in cui un linked server non sia già presente, esso viene creato almomento.

[Properties].[GetRemoteQueryResult]

Questa SP è utilizzata per eseguire una query su un server remoto. Iparametri di input sono:

• @intTicketID: Identificativo del ticket

• @strRemoteQuery: Testo della query da eseguire

• @intEntityID: Il target della query ( Company-Db o SBO-COMMON)

Questa query richiama [Properties].[GetHostInstance] per recuperarel’host e la istanza in cui il database è stato ripristinato. Quindi richiama[Properties].[LinkedServerConn] per acquisire il nome del linked server edinfine richiama [Properties].[ExecRemoteQuery] per eseguire la query sulserver remoto e tornare il dataset contenente il risultato.

[Properties].[GetSavedQueryResult]

Questa query esegue una query su linked server remoto e torna il risul-tato. A differenza di [Properties].[GetRemoteQueryResult], la query daeseguire in questo caso è salvata su db. Tale SP è pensata per l’esecu-zione di query ricorrenti, ossia query comunemente eseguite durante leprocedure di pre/post-restore, pre/post-backup. Gli unici parametri diingresso sono in questo caso il TicketID e il QueryID. L’uscita è data dalResult Set.

4. Implementazione 42

GetHostInstance

strHost strInstance

intTicketID

LinkedServerConn

ExecRemoteQuery

strLinkedServer

RESULTSET ( xml representing a datatable )

intTicketID strRemoteQuery GetRemoteQueryResultintEntityID

EntityID: 1 – CompanyDB 2 – SBOCOmmon

Figura 4.5: Stored Procedure GetRemoteQueryResult

[Properties].[GetHostInstance]

Questa SP è una semplice query che prende come parametro di ingresso ilTicketID e ritorna l’Host e l’Istanza in cui il database è stato ripristinato.

[Properties].[ExecRemoteQuery]

Questa SP è sviluppata utilizzando il Sql Server CLR per l’esecuzione delcomando EXECUTE(’strRemoteQuery’) AT [strLinkedServer], ovverosiaper eseguire una query su linked server remoto e acquisirne il risultato.è stato necessario in questo caso ricorrere all’uso del CLR in quanto SqlServer non lascia nidificare 2 comandi EXECUTE.

Le due possibili soluzioni erano l’uso del CLR o l’uso della SP disistema sp_executesql. In questo caso è stato scelto di utilizzare il CLRsolamente per la sintassi più chiara.

4.1.6 Indici