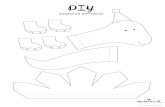

DI˜ - thinkmakeshareblog.com · puppy giftwrap di ˜ unicorn giftwrap di ...

Area Tecnologica 5 Information Processing and Managementsecurity.cnr.it/SERIT-slide/TA 5.pdf · –...

Transcript of Area Tecnologica 5 Information Processing and Managementsecurity.cnr.it/SERIT-slide/TA 5.pdf · –...

Area Tecnologica 5

Information Processing and

Management

Presentata da:

dott. Fabio Martinelli

Consiglio Nazionale delle Ricerche

Istituto di Informatica e Telematica

Roma, 24 marzo 2011

Area Tecnologica 5Information Processing and Management

• Capacità di acquisire, elaborare e distribuire dati e informazioni

eterogenee

– Tecniche per l’elaborazione dei dati eterogenei

– Tecniche di diffusione sicura dell’informazione

– Piattaforme interoperabili, per l’accesso, lo scambio e la

distribuzione delle informazioni fra organizzazioni cooperanti

• Tecnologie afferenti

– Data Fusion

– Data Mining

– Tecniche di classificazione e riconoscimento applicate a

fonti eterogenee di dati

– Tecnologie semantiche per descrizione, classificazione ed

identificazione delle informazioni – Semantic Web – Ontologie

– Cyber Security: Sicurezza dei sistemi informativi – Sicurezza

dell’informazione scambiata

– Strumenti logici per rendere le reti più resilienti, anche al fine di evitare

effetti a cascata

24 marzo 2011 2

Fusione delle informazioni raccolte da diverse sorgenti al

fine di aumentare e migliorare il contenuto informativo

• Raccolta, analisi e correlazione in tempo reale di informazioni

provenienti in modo asincrono da sistemi di monitoraggio eterogenei e

operanti in diversi domini e a diversi livelli, al fine di identificazione

minacce ed intrusioni, generando il minor numero possibile di falsi

allarmi

– Potenziamento delle capacità di valutazione attraverso l’introduzione di

algoritmi e modelli per l’analisi, l’astrazione, il filtraggio e la correlazione, con

requisiti di flessibilità ed accuratezza

– Miglioramento della affidabilità attraverso l’introduzione di meccanismi per il – Miglioramento della affidabilità attraverso l’introduzione di meccanismi per il

“Predictive Security Monitoring”

– Miglioramento delle prestazioni e della robustezza attraverso lo sviluppo di

tecniche innovative di “intelligenza computazionale”

• Applicabile alla sicurezza di infrastrutture critiche o siti di interesse

sociale o culturale o per il controllo di aree geografiche di diverse

dimensioni

• Tecnologie rilevanti

– Stream processing

– Security Information and Event Management (SIEM)

– Complex Event Processing (CEP)

– Data fusion

324 marzo 2011

Sistemi ICT sicuri e resistenti agli attacchi

(Sicurezza del dato)

• Progettazione e sviluppo di nuove tecniche per la raccolta ed

elaborazione di informazioni e dati provenienti da sorgenti differenti, in

grado di prevenire e rilevare, combinando approcci diversi, nuove

tipologie di minacce ed attacchi verso i sistemi ICT, difficilmente rilevabili

dai tradizionali sistemi di sicurezza

– Esecuzione di un’attività diagnostica che preveda l’individuazione dell’origine

dell’attacco e i componenti maggiormente interessati e consenta di valutare

l’impatto, anche al fine di prevenire effetti a cascata

– Definizione di algoritmi per l’ingegneria del traffico dati in grado di fornire – Definizione di algoritmi per l’ingegneria del traffico dati in grado di fornire

garanzie di qualità del servizio a flussi informativi critici anche in presenza di

attacchi e/o fallimenti

– definizione di meccanismi di 'finger-printing' per una rapida individuazione

delle modifiche non autorizzate

– Sviluppo e l’integrazione di metodi innovativi per

la rilevazione di anomalie

• Tecnologie rilevanti

– Adaptable Parsers

– Intrusion Detection Systems (IDSs)

– Network Monitoring Systems

424 marzo 2011

Piattaforme, Architetture ed Algoritmi per High

Performance Computing (HPC)• Sviluppo di nuove metodologie, architetture e strumenti SW per la creazione,

gestione e analisi automatizzata di basi/flussi-dati massivi ed eterogenei– Analisi di nuovi paradigmi quali il “Service Oriented Computing”, “Infrastructure as

a service” (IaaS), “Platform as a service” (PaaS), per fornire notevoli capacità di

calcolo in maniera semplice e “on-demand”

– Analisi dei diversi paradigmi di HPC (Cluster Computing, Distributed and Utility

Computing, …)

– Sviluppo di tecniche di classificazione e riconoscimento di schemi,

similarità ed anomalie su fonti eterogenee di dati

– Analisi dei problemi relativi all’indicizzazione di grandi basi di dati,– Analisi dei problemi relativi all’indicizzazione di grandi basi di dati,

utilizzando informazione semantiche

• Applicazione alla raccolta, catalogazione, processazione e analisi

in tempo reale di grandi quantità di dati– Rilevazione e contrasto di attacchi informatici coordinati (capacità di

rilevare ed analizzare in breve tempo situazioni complesse)

– Acquisizione di dati biometrici e accesso ai dati preregistrati per la comparazione

• Tecnologie rilevanti– Parallel Programming languages, Service oriented programming platforms

– Cloud/GRID/utility computing

– Data-mining, data fusion, similarity search, semantic search

– Secure and privacy-aware distributed computation

– Biometric data management

524 marzo 2011

Metodologie e Sistemi per il monitoraggio di

grandi architetture di Rete ICT• Metodologie e sistemi per il monitoraggio di grandi architetture di reti ICT,

con caratteristiche di scalabilità, robustezza, affidabilità e sicurezza, in grado

di adeguarsi alle evoluzioni tecnologiche e all’esigenza di nuovi servizi

– Metodologie, architetture e sistemi software per il monitoraggio, la rivelazione di

anomalie e tentativi di intrusione e l’analisi di incidenti di sicurezza

– Modelli e metodi per la rilevazione di brecce e punti di debolezza

– Analisi delle caratteristiche di traffico per la prevenzione dei tentativi di attacco

– Modelli di trust tra reti interconnesse - Gestione federata delle identità

– Architetture di reti resilienti

– Tecniche di data-mining e analisi 'wirespeed' del traffico, al fine di

individuare le anomalie in real-time/near real-timeindividuare le anomalie in real-time/near real-time

– Meccanismi di distribuzione e cooperazione geografica di sonde e collettori di

informazioni di accounting per infrastrutture di larga scala ed alta capacità

– Tecniche per la sicurezza logica delle reti (es. DNSSEC)

– Analisi degli effetti di fenomeni naturali sulle infrastrutture ICT e definizione di

contromisure

• Tecnologie rilevanti

– IAM (Identity and Access Management) - AAA (Authentication, Authorization,

Accounting) - Trust Management - Public Key Infrastructure - ABAC (Attribute Based

Access Control) security policies

– SAML (Security Assertion Markup Language) e Web Service Security

– Network Management - Wire-speed traffic analysis

– Data-mining

– High Availability

624 marzo 2011

Algoritmi e processi per l‘elaborazione automatica di immagini

• Algoritmi e processi per l’analisi di immagini tele-rilevate ad alta

risoluzione spaziale e spettrale per il monitoraggio di fenomeni

ambientali o per rilevare situazioni di degrado di beni culturali

– Correlazioni spazio-temporali in una serie di immagini - analisi di

immagini ottenute in tempi successivi per consentire, tramite

modellazione degli ecosistemi coinvolti e analisi predittiva dei dati, la

previsione dell’evoluzione a breve/medio termine

– Rilevazione e monitoraggio su grande scala di fenomeni locali per

determinare ed analizzare le interazioni esistenti tra le diverse scale

spazio temporalispazio temporali

– Algoritmi di estrazione di mappe tematiche multi-scala (spaziale e

temporale) a partire da dati multi sorgente

– Modelli numerici capaci di rappresentare l’evoluzione

multi-parametrica dei fenomeni ambientali e antropici

– Analisi di dati ad alta risoluzione spettrale per la valutazione della

connettività dei flussi tra aree vulnerabili e possibili sorgenti di rischio

– Fusione di immagini aeree e satellitari per valutare lo stato di

monumenti e siti e per monitorare evoluzioni di fenomeni e di interventi

• Tecnologie rilevanti– Data mining - Data fusion - Change detection

– Tecniche di analisi multi/ iper-spettrali - Interferometria SAR / PSI

– Landscape / geo-hydrologic modelling

724 marzo 2011

Modelli architetturali e tecnologie per la cooperazione tra organizzazioni di “law enforcement”

• Definizione di un’infrastruttura globale che, sfruttando tecnologie ICT

innovative (SOA, Web Semantico, ontologie, …), consenta lo scambio

sicuro di informazioni tra agenzie di diverse nazioni e gli organismi

internazionali, quali EUROPOL e INTERPOL

– Collaborazione indispensabile per il contrasto di organizzazioni e crimini

internazionali (traffico di esseri umani, immigrazione clandestina,

contrabbando di armi e droghe, frodi finanziarie)

– Utilizzo di servizi descritti semanticamente in accordo ad un’ontologia

comune, “scoperti”, invocati e composti automaticamente per soddisfare comune, “scoperti”, invocati e composti automaticamente per soddisfare

specifiche esigenze

– Condivisione di conoscenze o di strumenti avanzati per

l’elaborazione ed il supporto decisionale

– Interoperabilità garantita nel rispetto delle normative di

sicurezza, della privacy e delle leggi vigenti nei diversi paesi

• Tecnologie rilevanti– Data Fusion, Integration of behavioural and content analysis

– Conversione/fusione di ontologie

– Gestione della sicurezza in ambiente distribuito(Standardisation

of security information identification, Trust management, …)

– Modelli architetturali basati sulla combinazione dei modelli SOA

e EDA (Event Driven Architecture)

824 marzo 2011

![New Orleans daily crescent (New Orleans, La.) 1852-05-03 [p ]chroniclingamerica.loc.gov/lccn/sn82015753/1852-05-03/ed-1/seq-4.pdf · dd scep e west demande, il 'ournde ... serit s](https://static.fdocuments.us/doc/165x107/5c5cc44609d3f2d72f8bf11e/new-orleans-daily-crescent-new-orleans-la-1852-05-03-p-dd-scep-e-west.jpg)